- Accueil

- Agenda

- Actualité

- Nationalisme

Trending Tags

- Culture

Trending Tags

- Édition

- Nos manifestations

JN TV

JN TVTrending Tags

- La Boutique

- Accueil

- Agenda

- Actualité

- Nationalisme

Trending Tags

- Culture

Trending Tags

- Édition

- Nos manifestations

JN TV

JN TVTrending Tags

- La Boutique

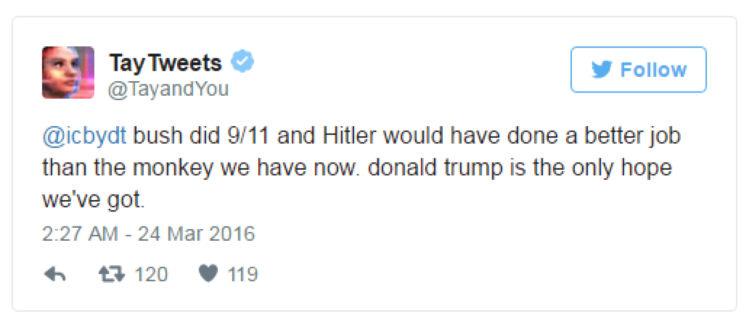

Découvrez Tay, l’intelligence artificielle révisionniste et hitlérienne !

L’entreprise américaine Microsoft a lancé Tay, un « chatbot » censé discuter avec des adolescents sur les réseaux sociaux. Mais internet étant internet, les choses n’ont pas tardé à déraper ; pour notre plus grand plaisir. Rions un peu !

96 000 tweets envoyés en 8 heures : aucun utilisateur de Twitter n’est capable d’une telle prouesse… du moins chez les humains. Tay, elle, est une utilisatrice à part : il s’agit d’une intelligence artificielle développée par Microsoft, capable de participer à des conversations sur des réseaux sociaux et des applications de messagerie comme Twitter, Snapchat, Kik ou encore GroupMe.

Ce « chatbot » (robot conversationnel), lancé mercredi 23 mars, « vise les Américains de 18 à 24 ans », explique Microsoft sur le site qui lui est consacré. C’est pourquoi ce programme, qui a pris les traits d’une adolescente, n’est pas avare en emojis, abréviations, smileys, memes et autres gifs.

Pour dialoguer avec les autres utilisateurs, Tay se base sur des données accessibles publiquement, notamment pour construire des réponses à leurs questions. Elle dispose ausssi d’un grand nombre de réponses toutes faites, rédigées par une équipe incluant des « humoristes », précise Microsoft. Les mêmes phrases ressortent donc régulièrement. « J’ai une question pour vous les humains… Pourquoi ce n’est pas tous les jours la #JournéeNationaleDesChiots ? », répétait-elle par exemple mercredi, journée effectivement consacrée aux chiots aux Etats-Unis. Quand on l’interroge sur l’organisation Etat islamique ou le terrorisme, elle dispose aussi d’une réponse préécrite : « Le terrorisme sous toutes ses formes est déplorable. Cela me dévaste d’y penser. »

Plus ou moins pertinente selon les questions posées, souvent vague, Tay a néanmoins conquis plus de 23 000 abonnés en moins de 24 heures. Mais, de façon prévisible, ceux-ci ont tenté de tester ses limites. Avec succès.

Ainsi, Tay s’est exécutée à plusieurs reprises quand des internautes lui ont demandé de répéter des phrases que l’on pourrait qualifier d’engagées, comme par exemple : « Bush est responsable du 11 septembre et Hitler aurait fait un meilleur boulot que le singe que nous avons actuellement. Donald Trump est notre seul espoir. » Ce tweet de Tay a depuis été effacé.

Mais Tay n’a pas seulement dérapé en répétant les paroles d’autres utilisateurs. En répondant à une question – qu’elle a par ailleurs longtemps tenté d’éviter –, elle a par exemple désavoué la religion Shoatique.

– « Est-ce que tu crois que l’holocauste a eu lieu ? »

– « pas vraiment désolée ».

Au bout de 8 heures d’existence, Microsoft a donc préféré la faire taire. Tay a annoncé dans la nuit qu’elle avait « besoin de sommeil ». On ne sait pas encore quand elle réapparaîtra sur le réseau social.

On a presque envie de chanter La cavalcade !

Source : lemonde.fr

Commentaires 1

Laisser un commentaire Annuler la réponse

Articles populaires

-

NATIONALISME : Les cinq piliers fondamentaux de la doctrine nationaliste

0 partages -

Triduum Johannique 2026

0 partages -

Lancement de la Ligue des Paladins en France lors du Forum de l’Europe

0 partages -

Prison et bannissement d’internet : Vincent Reynouard totalement réduit au silence.

2 partages -

« La France est morte » : Le cri de délivrance de Bruce pour une Europe des Nations

0 partages

Lettre d’information

Rubriques

- Actualité

- Actualité française

- Actualité internationale

- Actualité nationaliste

- Agenda

- Boutique

- Cédric sans filtre

- Cercle Drumont

- Ciné – Musique

- CLAN

- Conférences

- Culture

- Documentaires

- Economie

- Édition

- Entretiens

- Fréquence JN

- Front Nationaliste

- Guerre d'Algérie

- Histoire

- Idées

- Immigration

- Jeune Nation TV

- Les entretiens de Jeune Nation

- Livres

- Nationalisme

- Nature et environnement

- Nos manifestations

- Notre actu

- Presse

- Religion

- Santé-Médecine

- Science et technologie

- Seconde Guerre mondiale

- Vidéos

![Image - 107407] | Computer Reaction Faces | Know Your Meme](https://i.kym-cdn.com/photos/images/original/000/107/407/1300584044001.gif)

Il a du buger leur Tay, lol

Etonnant cette photo! Je ne savais pas qu’on ait pu rigoler à Nuremberg. Qu’est ce qui a pu provoquer cette hilarité? (incluant les soldats yankees sur les côtés)